- Vitalik Buterin podkreślił konkretne zagrożenia AGI, wzywając do ukierunkowanych rozwiązań zapewniających przyjęcie bezpiecznej technologii.

- Współzałożyciel Ethereum opowiadał się za decentralizacją i samodzielną opieką w celu ochrony ekosystemów kryptowalut i sztucznej inteligencji.

Jako doświadczony inwestor kryptowalutowy z dziesięcioletnim doświadczeniem w poruszaniu się po stale zmieniającym się krajobrazie cyfrowym, ostatnie spostrzeżenia Vitalika Buterina na temat ryzyka AGI głęboko do mnie przemawiają. Jego doświadczenia życiowe odegrały kluczową rolę w ukształtowaniu jego spojrzenia na technologię, a skupienie się na konkretnych wektorach ataku, zamiast postrzegania AGI jako abstrakcyjnej jednostki, wydaje się podejściem praktycznym.

Dyskusje na temat osiągnięcia sztucznej inteligencji ogólnej (AGI) zostały ponownie wywołane wraz z zaprezentowaniem najnowszego modelu OpenAI, nazwanego O3.

Jako inwestor w kryptowaluty jestem podekscytowany niezwykłym postępem O3, który uzyskał imponujące 87,5% w benchmarku ARC-AGI. Ten punkt odniesienia ma kluczowe znaczenie dla pomiaru postępu w kierunku ogólnej sztucznej inteligencji, a osiągnięcie to oznacza znaczący skok w rozwoju sztucznej inteligencji.

Jednak oprócz ekscytacji utrzymują się obawy dotyczące potencjalnych zagrożeń, jakie może stwarzać AGI, jeśli przekroczy ludzkie możliwości poznawcze.

Buterin o potencjalnych zagrożeniach AGI

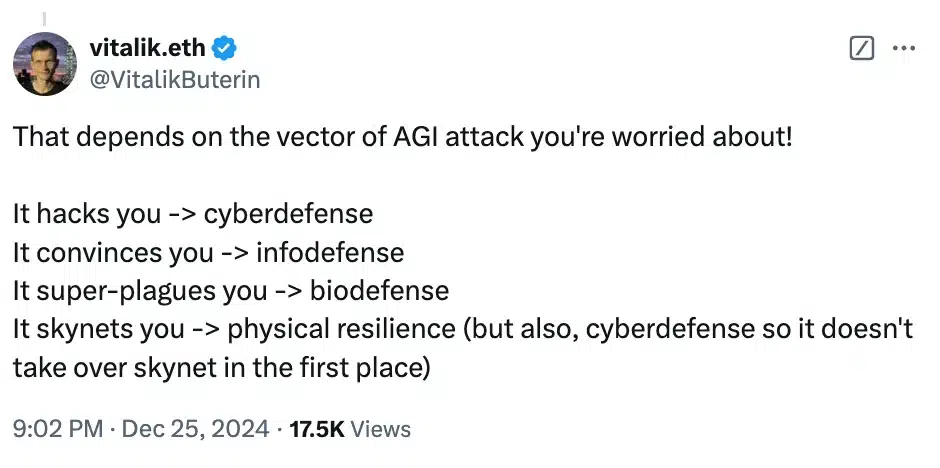

Mówiąc na ten temat, współtwórca Ethereum, Vitalik Buterin, wyraził swoje obawy dotyczące możliwych zagrożeń, jakie może powodować sztuczna inteligencja ogólna (AGI).

Na X Buterin podzielił się znaczącymi przemyśleniami na temat potencjalnych ścieżek rozwoju sztucznej inteligencji, które mogłyby prowadzić do skalowalności i powszechnej akceptacji.

Podkreślił znaczenie stawienia czoła znaczącym wyzwaniom, jakie może nieść AGI w miarę jego większej integracji z głównymi zastosowaniami.

Zauważył,

W tym kontekście Buterin twierdzi, że traktowanie AGI (sztucznej inteligencji ogólnej) jako niezłomnej i nieuchwytnej siły jest błędne. Zamiast tego podkreśla znaczenie skupienia się na możliwych do zidentyfikowania lukach w zabezpieczeniach lub punktach ataku podczas jego opracowywania i wdrażania.

Następnie podkreślił potencjalne ryzyko.

Należą do nich wykorzystywanie przez AGI luk w zabezpieczeniach oprogramowania, rozpowszechnianie dezinformacji w celu manipulowania ludźmi, wdrażanie cyfrowych agentów biologicznych, przejmowanie kontroli nad infrastrukturą fizyczną lub całkowite przekraczanie ludzkiej inteligencji.

Jak to wszystko się zaczęło?

W świetle komentarzy Balaji’ego dotyczących szybkiego postępu innowacji technologicznych jego odpowiedzi wywołały dalsze debaty na temat potencjalnych konsekwencji ewolucji sztucznej inteligencji ogólnej (AGI).

W tej samej dyskusji Buterin zauważył, że kryptowaluta to tylko jeden aspekt szerszego obrazu. Podkreślił jego powiązanie z szerszymi strategiami nastawionymi na wzrost i rozwój.

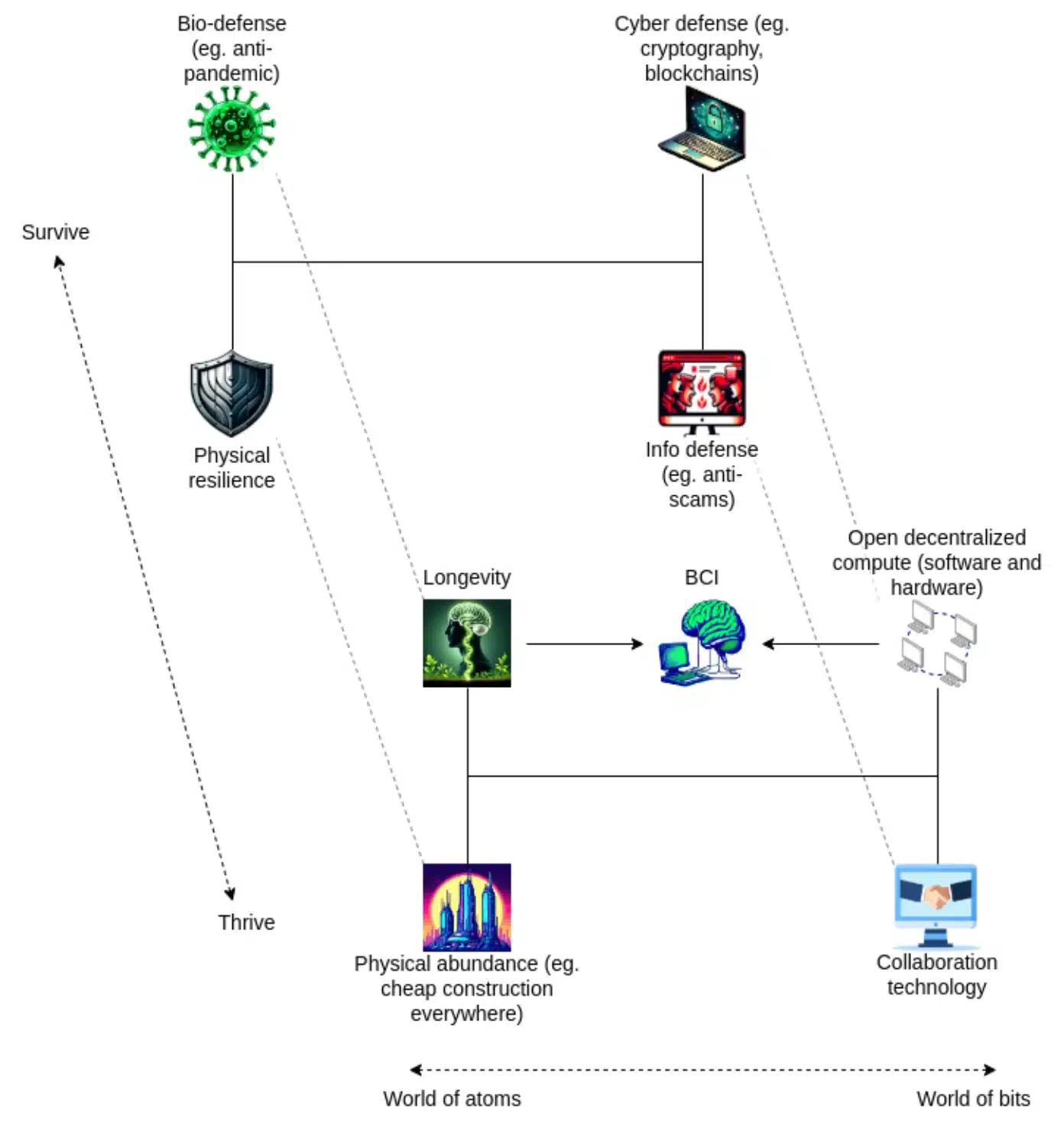

Jako badacz miałem dostęp do szczegółowego schematu, który elegancko zestawiał namacalną sferę atomów z abstrakcyjnym krajobrazem bitów. Ta wizualizacja posłużyła do podkreślenia dynamicznej interakcji pomiędzy tymi dwiema odrębnymi sferami.

Co więcej?

Jednak Buterin podkreślił znaczenie ochrony powstających technologii, podkreślając, że samoopieka nie jest częstym rezultatem w obecnym środowisku kryptowalut.

Dodatkowo podkreślił potencjalne zagrożenia związane ze scentralizowaną strukturą w obrębie systemów kryptowalut i sztucznej inteligencji. Użytkownicy często polegają na pośrednikach, takich jak giełdy, co może skutkować słabymi punktami, takimi jak naruszenia lub zła administracja.

Podkreślając potencjalne zagrożenia ze strony nieuczciwych osób, takich jak oszuści wykorzystujący technologię, na przykład asystent AI Elona Muska, Buterin zaproponował system oparty na decentralizacji.

Podkreśliło to, że współzałożyciel przewiduje sztuczny Internet rzeczy, w którym klucze prywatne zapewniają użytkownikom pełną kontrolę, ograniczając potencjalne ataki na technologie takie jak inteligentne domy.

Podsumowując, Buterin stanowczo podkreślił, że rzeczywiście można osiągnąć akceptację głównego nurtu, wzywając wszystkich do aktywnego udziału.

„Musimy do tego wyraźnie dążyć”.

- USD PLN PROGNOZA

- EUR PLN PROGNOZA

- SUI PROGNOZA. SUI kryptowaluta

- Jak siostry żony zareagowały na śmierć Garrisona Browna w premierze sezonu

- Wyjaśnienie zakończenia 4. sezonu „Outer Banks”: Kto umarł? Czy któraś para się rozstała?

- USD RUB PROGNOZA

- OM PROGNOZA. OM kryptowaluta

- Channel Seven zatrudnił kontrowersyjną gwiazdę NRL do przedstawienia segmentu ligi rugby po krwawej łaźni w sieci

- Joshua Jackson podsyca plotki o romansie z niemiecką modelką Nastassją Roberts na premierze Grotesquerie… w związku z jego związkiem z Lupitą Nyong’o

- Leonardo DiCaprio (49 l.) wygląda powściągliwie, opuszczając imprezę z okazji Tygodnia Mody w Paryżu z modelką Neelam Gill… ale nigdzie nie widać dziewczyny Vittorii Ceretti

2024-12-27 07:03